我们终将泄露的人脸数据,后果到底有多可怕?

从朋友圈里的AI面相识别小程序,到走进大街小巷的AI测肤,无一不是热火朝天。

这种情形不禁让人感叹,互联网的记忆果真连金鱼都不如。想当初iPhone X刚刚推出人脸识别解锁时,网民们都在警惕人脸的安全,声称外出行走要戴上「脸基尼」,以防路边有歹徒冲出来突然拍照获取自己的人脸数据。

如今才过了一年,大家就忘记了被「人脸泄露」所支配的恐惧。

你在寻找明星脸,吃瓜群众在谷歌上找到你的脸

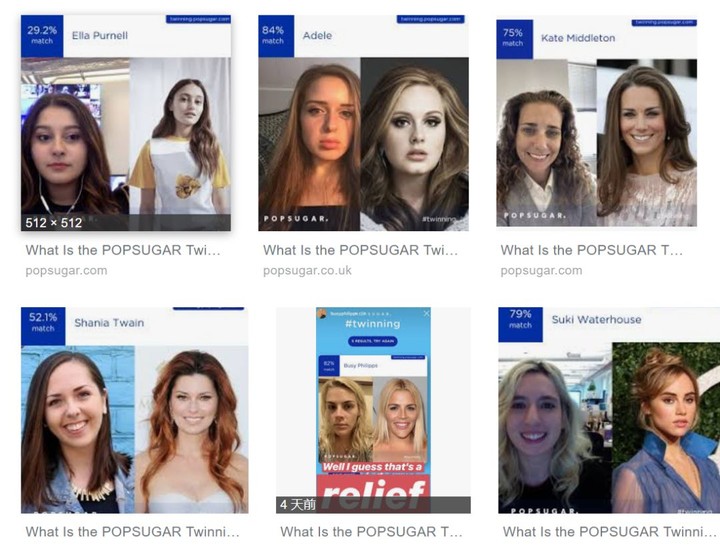

最近在美国有一家名为POPSUGAR的企业推出了一款名为Twinning的爆款应用,Twinning的功能很简单,用户只需上传照片,就能通过人脸识别找到与其容貌最相似的明星。可就是这样简单的功能,却在Instagram和Twitter上产生了病毒传播,就连很多明星都进行尝试并且在社交媒体上分享了结果。

可就是这款爆款应用,产生了非常严重的信息泄露。Twinning的照片储存利用的是AWS的云服务,但在权限设置中却产生了很大的错误。在Twinning的网站代码中,可以直接找到云服务器地址,进去后就能直接看到用户实时上传的信息流。现在在谷歌搜索中,还能看到不少泄露出来的照片。

这也让很多人再次回想起人脸数据的安全的问题,随着人脸识别API接口越来越开放和廉价,提供人脸识别服务的门槛也日渐降低。

正常化的人脸扫描,或许不会伤害谁

▲ (明明就不像!)

可同时我们也要弄明白,人脸数据泄露到底有哪些风险呢?

其中可能性最大的,就是像Twinning那样,权限设置失误,将用户照片泄露出去。但对于大多数人来说,这种隐私泄露的杀伤力其实也就和有人手贱将你朋友圈里的自拍发到微博上差不多。

有人又要说了,现在到处都能靠人脸付款、申请贷款等等,会不会有人通过娱乐性的小程序收集了我的人脸数据,然后去破解我的支付宝账号呢?

这个问题从技术上来看,大多数人脸支付、人脸安防都具有活体检测功能,很难通过照片去破解。即使是通过3D打印人脸面具来破解,也需要完善的3D结构光脸部扫描才能生产出足以对于人脸识别的面具。只要用户没有傻到对着来路不明的人脸识别应用摇头晃脑,基本也不会有相关数据流出。而且大多数应用和服务也不是光靠一张脸就要让用户付费,就算破解了「人脸密码」,没有用户名也是白瞎。所以担心别人抄袭你的脸,比担心走在大街上有歹徒会割下你的大拇指拿去指纹支付还要荒谬。

最终的疑窦是,这些人脸识别应用会不会把我们的人脸照片卖给数据公司,用作训练AI的「肥料」呢?

按理来说这种情况是最有可能发生的。但问题在于人脸根本就不是什么非常稀缺的数据,如今人脸识别技术能力的平均水平也不低,如果说收集数据,可能厂商们更需要的是暗光下的人脸,或一些特别角度下的人脸数据。大多数人脸识别应用所收集的毫无标注的数据,对于他们来说并没有什么卵用。

所以,虽然人脸泄露很容易发生,但人脸泄露带来的后果并没有大家想象中那么可怕。

剑指未来的人脸安全

第一是人脸3D数据的获取。

现在手机中的3D结构光普及程度还不够高,但长远看来3D结构光应用越来越广已经成为必然的趋势。这时人脸识别应用获取的就不再是一两张简单的照片,而可能是金融级、安防级3D人脸数据。如果这些数据泄露给不法分子,可能就真的会让3D打印面具破解人脸识别的情况大范围出现了。尤其是人脸这样具有唯一性的生物信息,一旦被复制后会给个人用户带来很大的麻烦。

相信和很多技术一样,人脸识别尤其是精度更高的3D结构光人脸识别,也会走过一段从滥用到规范的道路。在去年,中国泰尔实验室已经发布了《移动终端基于TEE的人脸识别安全评估方法》,对人脸采集、存储、比对等过程中的安全环境提出了严格的要求。但评估方法终究与法律法规不同,想要对安全问题进行约束,既要靠企业的自觉,也要靠用户的警惕。

简单来说,如果想保护自己的人脸信息,应该尽量避免使用小公司出产的美颜、人脸测试、皮肤测试等等硬件产品或App、小程序等。各种和商业挂靠的刷脸支付、专柜扫描检测皮肤,也可以先放一放,等待行业进一步规范后再进行。尤其是手机中有3D结构光功能的用户,更需要对相关产品谨慎对待。

但作为生活在现代社会中的人类,我们的脸不管怎样都时时暴露在各种设备下。在技术的风险下我们天生就是弱势群体,只有当我们自己意识到人脸安全的问题时,才能推动产业端的规范化。

本文来自微信公众号脑极体(ID:unity007 ),作者为我堂堂一个熊猫,爱范儿经授权发布,文章为作者观点,不代表爱范儿立场。