脑机接口研究新突破,把心里话转换成语音播放

如何让大脑思路清晰但患有失语症的人正常说话?现在有了新的研究成果。

▲ 视频来自腾讯视频

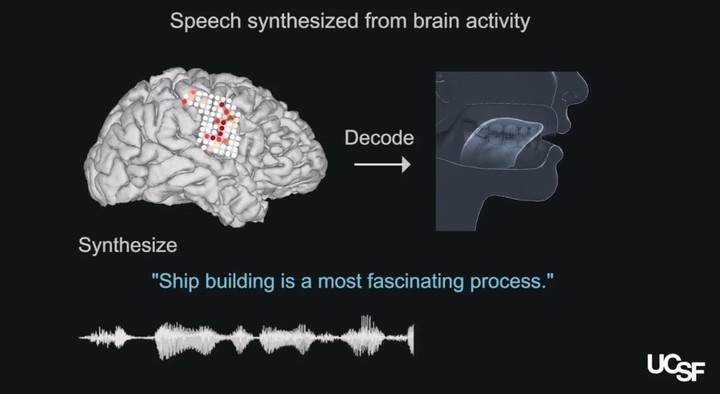

近日,加州大学的研究人员在《自然》杂志上发表的研究成果表明,他们所研发的人类语音合成系统,可以解码人类下颌、喉咙、舌头、嘴巴等发音部位的生物信号,最终合成受试者想要说的话。

也就是说,这个脑机接口系统可以将脑活动转化为语音,脑袋里的意念不用自己动嘴说,可以借助机器合成的语音表达出来。

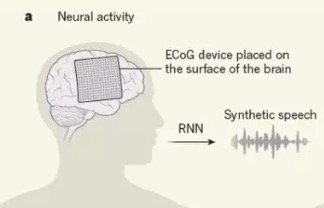

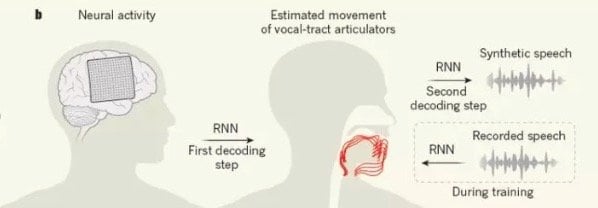

类似的研究早前也有人做过,主要是将脑活动直接解码为语音。此次研究的突破之处在于解码过程分成了两步,并降低了语音失真率。

第一步,声道、舌头、嘴唇等发音部位的运动由大脑控制,为了获得该过程脑信号与肌肉运动的关联,他们训练了一个 RNN 神经网络对这个过程进行深度学习。

第二步,把发音部位的运动,转换成合成的语音,这一步也使用了一个 RNN 神经网络。

有业内人士认为,该项研究可以帮助因疾病丧失语言功能的人,其中包括肌萎缩侧索硬化、中风等失语症患者。

著名科学家史蒂芬 · 霍金患有肌萎缩侧索硬化,数十年间委身于狭窄的轮椅,患病后的他曾通过单个按键的鼠标操作电脑打字,后来手部肌肉衰弱变,利用眼镜上的红外探测器识别眼球和肌肉的运动,最后通过语音合成器读出文本。

这种用残余肌肉控制机器打字的方式,虽然可以帮助患者对外表达,但速度很有限。要想让失语症患者能够流畅地表达,借助脑机接口和机器学习技术合成语音是一个有效的方向。

脑机接口(BCI,Brain Computer Interface)的相关研究从二十世纪八十年代就已经开始了,至今超过 30 年。

脑机接口技术主要是从大脑等神经中枢中提取特定的生物电信号,依据现有的认知神经科学理论进行解码,在与外部系统建立联系和沟通。可以让人与机器之间的协作达到「人机合一」的境界。

2004 年,布朗大学研发的 BrainGate 系统被植入到 13 个瘫患者大脑的运动皮层中。这个系统可以监测植入者的神经元,如果被植入者想要做出移动手臂等动作,大脑中的神经元就会释放电信号,BrainGate 再将这些电信号解码传送到人体外的系统。

BrainGate 已经让一个四肢瘫痪的女士在无看护的情况下喝到饮料,还让另一个四肢瘫痪的女士在飞行模拟器上驾驶 F-35 战斗机。

俄罗斯亿万富豪伊茨科夫于 2011 年创立了一个名为「俄罗斯 2045」的计划,企图打造人类的「不死之身」。这个计划有个基金的时间表:到 2020 年,要实现人脑对机器人「化身」的遥控;到 2025 年,要把人脑移植到机器人身上;到 2035 年,要破解人类大脑之谜,打造出「人造大脑」;到 2045 年,要创造出真实版的全息「虚拟人」。

这个人类永生计划的技术关键,就是脑机接口。

就目前而言,像《黑客帝国》或者《阿凡达》这些科技电影所呈现的脑机接口技术依然很遥远,不过这项技术已经逐渐在临床上用于恢复人体部分功能丧失。