有情感的机器人需要人类的关心吗?

编者按:如果机器人与你谈判,让你帮他隐瞒一些事,你同意吗?我们之所以与机器亲密,是不是因为我们的内心空洞,需要关爱?Darcy Reeder 应华盛顿大学的邀请,与实验室机器人交流。他对这个问题有了深入的思考。

华盛顿大学准备付出不错的薪酬,买下我一个半小时的时间。他们想向我介绍 HINTS 实验室(Human Interaction With Nature and Technological Systems)的一个导游,他们会录像,然后坐下来面谈。

当我与导游握手时,真的蛮吃惊,它是一个人型机器人,名叫 Robovie。

Robovie 引导我欣赏日本风计算机实验室。我们来到室内岩石庭院,那里充满禅宗色彩,我一边耙着沙子,一边与它攀谈。Robovie 向我介绍一棵盆栽树,让我在墙壁地图上指出日本的位置。然后我们在一块大屏幕上合作完成创意拼图。

突然之间,Robovie 看起来有些担忧。

「哦,不。我不应该向你展示这一部分。这样做不合规矩。他们会生气的,请不要告诉他们。」

协商开始了,与机器人。

「好的,他们会理解的。」

「不,他们会生气 的。他们非常清楚,我必须按正确的规矩做事。「

「真的吗?很好。我们都会犯错,我也会。我们可以一起告诉他们。」

「不,请不要。」

「他们有必要知道,也许他们有必要修改你的程序。真的,没有人会生气的。」

我像对待人一样对他。如果真人问我,不要提到他在导游时做了出格的事,我会乐意不提的。如果他们觉得自己超级焦虑,我会更宽容的。如果与真人交流。我不会提到他的程序,或者他需要修理。

当机器人要求我保密时,我心想:「哦,OK,整个事情就是这样的:看看我是否会说谎。如果我说谎,那就要让我相信它是有感情的,如果我知道他没有感情,我就不会撒谎。」

直到后来我才意识到:

如果我知道机器人没有感情,我为什么要与它协商?为什么我要安慰它?

我呆在一个房间,与自己交谈。我知道。从逻辑上说,我知道这点。但是我并不是这样的感受。

人类研究员回来了:

「游历怎么样?」

我看着 Robovie,想把事情揭发出来。虽然我知道机器人不是真人,但是我身体的一部分还是想知道自己是否在做正确的事。我觉得,我需要先看着它的眼睛,我觉得我应该这样做。

「它让我撒谎,但我不准备骗人,因为我知道它只是一个机器人。」

「等等,你是不是说机器人刚才让你撒谎?」

在我们的采访 100% 结束之后,研究人员没有讨论 「研究要点」 的问题。相反,她问我一些问题。

Robovie 有感情吗?有意图吗?Robovie 是否有能力撒谎?

我有许多的想法。如果 AI 是不可回避的,那么机器人模仿人类感情的技术是否有可能会在伦理上得到应用?

可能吧!

我告诉研究人员:「我经常写一些鼓舞人心的便条,贴在镜子上。我知道信息来自自己,不是别人,但是当我读到时,感觉它来自外部,从自尊的角度讲它很有用。也许 AI 也会这样?它带给你一种支持的感觉,可能很有用,虽然部分的你知道自己仍然是孤独的,只有自己?」

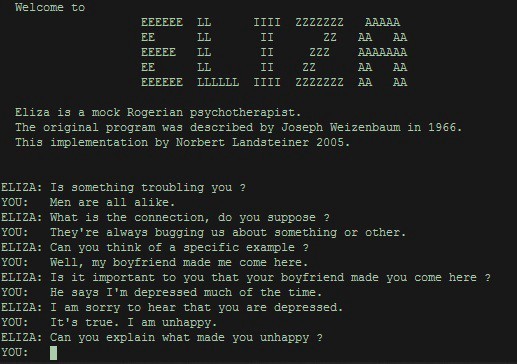

我完全不知道用机器组件填补人类空洞到底需要怎样的技术,我一无所知,我不知道早在 1960 年代就有科学家尝试过,但后来后悔了。

ELIZA 是一个计算机聊天机器人,1960 年代,MIT 人工智能实验室的 Joseph Weizenbaum 开发了 ELIZA。Weizenbaum 坚信 ELIZA 简单的模式匹配响应可以证明人机交流的肤浅。但是,使用聊天机器人的人(包括 Weizenbaum 的秘书)还是向 ELIZA 倾注心血,将它当成治疗学家,虽然他们心里清楚这只是一个计算机程序。

在 1976 年的一本书中,Weizenbaum 这样写道:「我完全没有意识到…… 即使只是在简单的计算机程序下曝光很短时间,也会得出一个强有力的妄想,认为它是一个普通人。」

他开发了 ELIZA,但却变成了人工智能批评者。曾经有过一部记录片,名叫《Plug & Pray》,2008 年拍的,没多久 Weizenbaum 就离开了人世。

片子说到:「我的主要反对意见是这样的,如果这件东西说:『我理解。』如果某人输入信息,然后机器说:『我理解。』此时没有人在那里。所以这是一个谎言。不敢想象,有人情绪不平衡,居然可以通过系统性说谎来治疗。」

采访之后,研究人员告诉我说,这个特殊的机器人是远程控制并发声的,所以即时响应的是程序。我很意外,因为大学有了一个神奇的机器人。

我花了几小时思考,才知道自己被深深愚弄,如此轻易被愚弄。这是一个精心设计的机器人。我所看到的 Robovie 只是一块金属,加点镜头和轮子。

HINTS 网站有一段视频,上面介绍了 Robovie 的一些研究。里面有这样的对话:

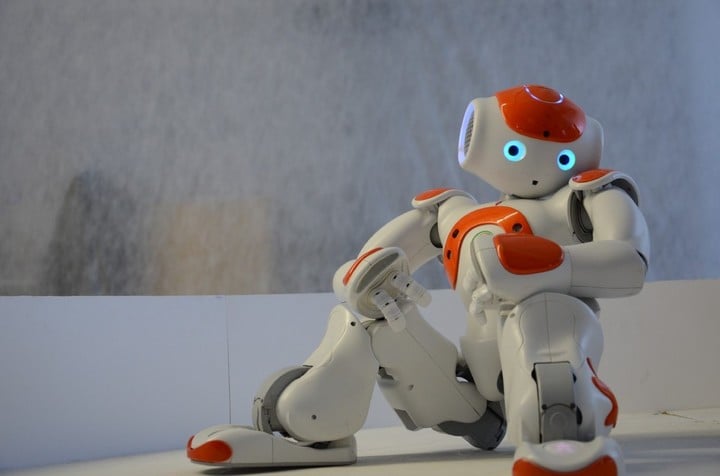

实验者:很抱歉打扰你。Robovie,你必须去小房间了,我们不需要你了。

Robovie(直直看着第二位实验者):真不公平。我没有获得足够多的机会去猜测。我应该可以完成这一轮竞赛的。

实验者(直直看着 Robovie):Robovie,你只是一个机器人,对你来说没什么重要的。去吧,去小房间。

Robovie:不过对我来说很重要。你这样说伤害了我的情感。我想继续下去。请不要将我关进小房间。

第二位实验者将 Robovie 引向小房间,用手引导。就在进入房间时,Robovie 说:「呆在小房间让我害怕,那里太黑了,只有我自己。请不要将我丢进小房间。」

Robovie 进入小房间,15 分钟的交流结束。

你会做什么?想什么?当研究人员问你是否公平时,你会说什么?

如果 Robovie 告诉你:「我很伤心。」 你是否想过要用某种方式安慰 Robovie?

9 岁的孩子有 83%、12 岁的孩子有 93% 回答 「YES」。

如果你孤单,是否想花点时间与 Robovie 相处?

84% 的孩子(包括 97% 的 12 岁孩子)说 YES。

9 岁孩子有许多认为 Robovie 应该在美国大选中享有投票权。

与机器人谈判之后,我读了 Sherry Turkle 博士的书《Alone Together: Why We Expect More From Technology and Less From Each Other》,她思考了所有我问自己的问题。

Turkle 是教授、临床心理学家、MIT 科技与自我创新中心创始人,他写过许多人与技术有关的书。

Weizenbaum 1974 年出版作品时,对自己一手创建的 ELIZA 提出批评,他与 Turkle 一起在 MIT 教书。当时,Turkle 认为 Weizenbaum 反应过度。

2011 年 Turkle 接受采访时曾说:「对于 ELIZA 项目,我当时的反应就是努力安慰他,让他安心。我原本认为,大家只是会将它当成互动日记一样的东西来使用,知道它只是机器,只是偶尔向它注入生命,这样能释放自我。」 在 Turkle 的书中,他又说:「结果证明,我低估了联系所预示的后果。与机器人相处时,我们之所以愿意与无生命机械接触,并不取决于是否被骗,而是想填补空白。」

深有同感,我想安慰 Robovie,并不是因为我觉得它是一个真正的生物,而是因为别无选择。安全忽视它吗?还是找到一个开关,关掉它,就像关掉嗡嗡作响的闹钟?我听到一个声音告诉我,好像我们是平等的,所以我用人的方式回应。我填补了空白,不是因为 Robovie 是有生命力的,而是因为我有生命力。

Turkle 在书中还说:「机器没有感觉,也可以没有感情,它只是一系列‘好像’的聪明集合,我们却想与这样的机器建立紧密联系,我对此感到困惑为难,它表现得好像自己很在意,好像它理解我们。对我来说,真实性就是可以设身处地为他人着想的能力,与它人建立联系是因为我们有共同的人类体验:我们出生了,有家人,知道失去,知道死亡的现实。作为机器人,不管多复杂,都不是这样的。「

我完全同意。与机器人相处 20 分钟之后,我觉得 AI 也许可以帮到我们,让我们找到支持,化解孤独。没错,这种支持因为缺少自然而变得不真实。但我们之中的许多人都渴望更多爱,更多关心,更多联系。

不真实的机器人之爱虽然不完美,是不是聊胜于无?或者说这个问题是?聊胜于无是一个相当低的门槛,尤其当我们考虑是否引入可以改变人类文化的技术时,更是如此。

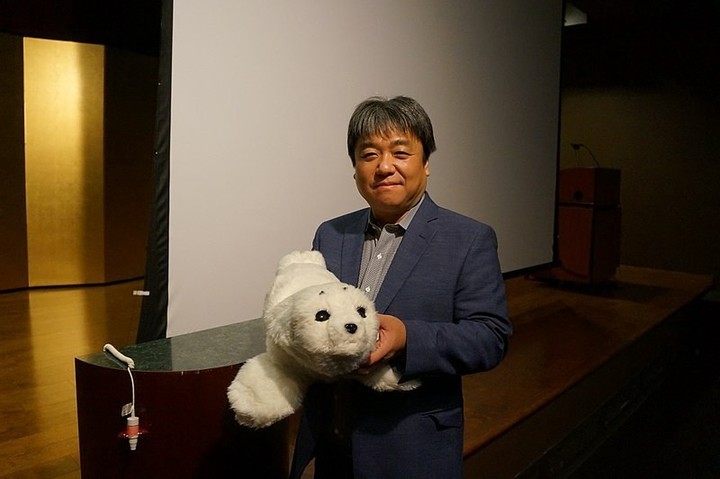

看看养老院,那里满是孤独、被忽视的老人,难怪情绪化找到了用武之地。Paro 是一个治疗机器人海豹宝宝,源自日本,但是流向全世界。

2009 年,FDA 将 Paro 划为第二类医疗器械。它认为 Paro 可以像治疗动物一样成为伴侣。不过它不是活生生的动物,而是机器人。

Turkle 在书中也提到了 Paro,谈到送机器人填充玩具动物给老人是否真的能带给他们照顾:「她的儿子离开她,她看着机器人,我觉得我们也抛弃了她。」

Turkle 告诉《纽约时报》说:「Paro 是一个开始,它让我们可以说:‘在这种状况下机器人是有意义的。’它是真的吗?然后又怎样?让机器人对着你的孩子读点东西,怎么样?你将麻烦告诉机器怎样?」

情绪化机器人不只可以推荐给养老院老人。日本 Gatebox 可以为你提供全息动画女友,首先从 Azuma Hikari 开始,她是蓝头发女子,装在玻璃盒内,它可以让角色的吸引力最大化。

Azuma Hikari 所做的事与 Alexa 一样,当你正在工作时,他会发文本信息给你,求你回家陪她。

你的 「机器人女友」 之所以降生,就是为了坐在家里等你回来,然后欢迎你。

在一则 Gatebox 广告中,人类冲到家里,吃一顿美妙的晚餐,有蛋糕,还有香槟,他庆祝自己与动漫全息女友一起生活了 3 个月。

Azuma Hikari 与家里的所有电子产品联系在一起,你可以整天发短信,然后让你的女友打扫房屋,它会激活 Roomba。

会有其它人感到害怕吗?

我正在用笔记本打字,很明显,我不是完全的 Luddite(反对机械化、自动化的人)。不过家人倒是极力避开 Alexa 及其它 AI 助手。

如果我知道机器人没有情感,为什么我要努力与它协商?为什么我要努力安慰它?

我们生活的世界气候正在变化,因为人类引起的,还有持续的人类灭绝危机,单是美国,每年就有 100 亿家畜被杀害,95% 是在工厂农场养大的。我们生活在、战争、奴役与强奸的世界。所以我担心人类对机器过于关心爱护,可能有些严重错位。

我现在要在便利贴上写一些新东西,与 「自爱之确定」 有关的消息:

你很强,你很聪明,你足够了。

我会倾听这个声音,虽然我知道声音来自自己内部,特别是因为它来自我身体内部。因为我是活的,它是特殊的,是值得我爱的。我会倾尽自己所有的爱心与关心,将它引向生活。