AI 新规则(一):亚马逊的 AI 向不良 UGC 宣战

本文来自 36 氪编译团队「神译局」,译者 boxi,爱范儿经授权发布。

人工智能诞生至今已有 60 多年,美国的一些最大型的科技公司(Amazon、微软、Google、Facebook 等)才刚刚开始挖掘 AI 的潜能,并设法弄清楚人工智能将如何改变我们的未来。本文是《Fast Company》汇编的系列文章 「AI 的新规则」 的第一部分,介绍的是 Amazon 的机器视觉服务 Rekognition。原文作者是 Mark Sullivan,标题为:Amazon’s AI is democratizing the war on NSFW user-generated content

现在,Amazon 备受争议的 Rekognition 计算机视觉技术有了个新用途:用来删除食品网站上的那些不雅照片。

好吧,起码有一个例子。总部位于伦敦的送餐服务 Deliveroo 正面临着严峻的内容审核挑战。他们的订餐功能似乎有个问题,Deliveroo 客户经常会把食物的照片和投诉一起发出。他们经常会用不雅照片对吃过的食品发动照片炸弹袭击。又或者,他们会把食物排列成私处的形状。真的。

事实证明,Deliveroo 的员工未必就想看到类似的东西。因此,该公司使用了 Rekognition 来识别不雅照片,并在它们被人看到之前就对其进行模糊处理或删除。

Deliveroo 的问题体现出了一个日益严重的问题的离奇之处。许多互联网公司正在以这样或者那样的方式关注着 UGC(用户生成内容)。近年来,我们愈发看到其中展现出来的人性之阴暗面。随着网站日益成为假新闻、暴力内容,假冒伪劣品、欺凌、仇恨言论等有毒 UGC 的温床,内容审核已成为当务之急。如果你财大气粗如 Facebook 的话,可以开发自己的 AI 或雇用大批审核员(或两者兼有)来应对这种混乱局面。但是,资源较少的中小企业就没有这种选项里。Amazon 的内容审核服务就源于此。

该服务是 Amazon Web Services 的 Rekognition 计算机视觉服务的一部分,而后者本身就是很多不好新闻的主题,因为 Amazon 似乎愿意为美国移民与海关执法局提供脸部识别服务。你可以在 Rekognition 的网站上找到其他面向监视的应用案例,比方说它可以从不同的拍摄角度读取车牌,或者跟踪摄像头捕获到的人的行走路径。

Amazon 或许正在寻求对其计算机视觉服务进行更正面一些的曝光,所以这是它首次谈及用 Rekognition 来监视 UGC 里面的淫秽或暴力图片。该 Rekognition 内容审核服务可检测上传到公司网站的图像和视频当中不安全的或攻击性的内容。

这是一项增长业务。Amazon AI 副总裁 Swami Sivasubramanian 说:「UGC 所扮演的角色正在逐年激增,因为我们现在每天都要在社交媒体上跟朋友和家人分享两到三张图片。」 Sivasubramanian 说,Amazon 是从 2017 年开始应一些客户的要求提供内容审核服务的。

公司可以付费买 Rekognition 服务,这样就不必雇用人员来检查用户上传的图像了。跟其他 AWS 服务一样,内容审核服务采用即用即付模式,并根据 Amazon Rekognition 神经网络处理的图像数量来进行定价。

毫不奇怪,该内容管理服务的第一批用户包括了约会和婚介网站,这些网站面临着快速审批上传到用户个人资料的自拍照的挑战。Amazon 表示,婚介网站 Coffee Meets Bagel 和 Shaadi 使用 Rekognition 正是出于这个目的,帮助他人创建约会网站的葡萄牙网站 Soul 也是这个用法。

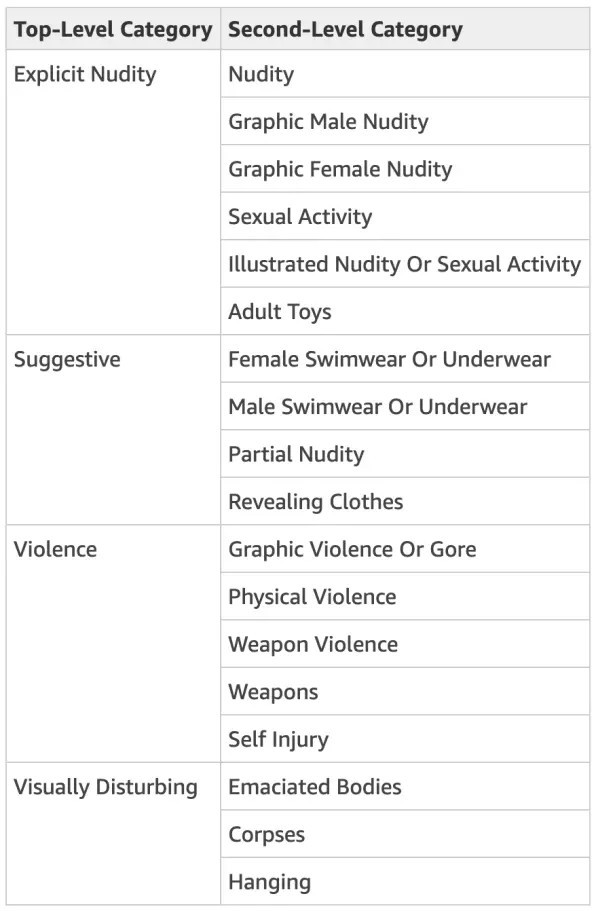

这个 AI 不是只会找裸体。Rekognition 的神经网络已经过训练,可以检测各种可疑内容,包括枪支或暴力图像或一般会令人不安的内容。下面是 Rekognition 网站上的功能分类:

▲ 图片来源:Amazon

工作机制

跟 AWS 的所有其他内容一样,Rekognition 的新内容审核功能也是在云端运行的。使用的公司可以告诉服务它要检测什么类型的问题图像。然后,它就会将用户生成的照片和视频(在许多情况下通常可能就是存储在 AWS 上的)发送给 Rekognition 服务。

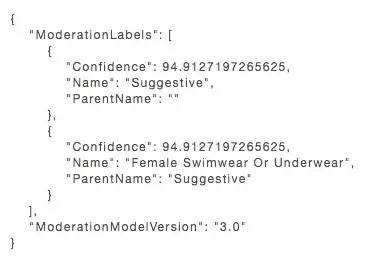

然后 Amazon 的深度神经网络就会对图像进行处理,从中发现内容并对任何可能令人反感的图像类型进行标记。神经网络会输出有关图像内容的元数据,以及表示对图像所打标签确信度的百分比。结果看起来是这样子的:

然后这段代码会发送给客户端的一个软件,该软件会根据编程好的业务规则来确定如何对标记的图像进行处理。软件可能会自动删除给定图像,放行通过或者对部分进行或模糊处理,或者将其发送给人类进行审查等。

进行图像处理的深层神经网络有很多层。每一层会评估代表图像不同方面的数据点,对它们进行计算,然后将结果发送给网络的另一层。网络会首先处理顶层的信息,比如图像里面的基本形状以及是否有人等。

Sivasubramanian 解释说:「然后它会慢慢地不断提炼,每往下一层就会获得更多和更具体的信息。」 慢慢地,神经网络就能不断明确出图像里面有什么内容。

AWS AI 副总裁 Matt Wood 表示,他的团队利用了数百万专有和公开可用的图像集来训练其计算机视觉模型。他说,Amazon 并没有在训练中使用任何的客户图片。

逐帧处理

一些最大的 Rekognition 内容管理客户并未使用该服务来审核 UGC。Amazon 表示,拥有大型数字视频库的媒体公司需要了解每一帧的视频内容。Rekognition 的神经网络可以处理每一秒的视频内容,用元数据对其进行描述,并标记可能有害的图像。

Wood 说:「有一件事情机器学习做得确实非常好,那就是剖析视频或图像然后提供额外的上下文。它可能会说,『这是一个女人带着小狗在湖边散步的视频』,或者『这个视频里面有个穿着衣服的男人』。」 他说,这种用法下,神经网络能够检测到危险、有毒或猥亵内容,而且准确率极高。

▲ 图片来源:Amazon

尽管如此,这一分支的计算机视觉科学尚未达到成熟。科学家们仍在寻找优化神经网络算法的新办法,从而能够更准确、更详细地识别图像。Wood 说:「我们还没有到达收益递减时候。」

Sivasubramanian 说,就在上个月,计算机视觉团队已经将误报率(误将图像错误地标记为可能不安全或令人反感的错误率)降低了 68%,将漏报率降低了 36%。他说:「这些 API 的准确度还有改善的余地。」

除了准确率之外,客户一直在要求提供有关图像分类更详细的信息。按照 AWS 网站的介绍,AWS 内容审核服务仅针对不安全图像返回主类和次类。所以系统可能会把图像归类为主类主要类别为包含裸体,而次要类别为包含性行为。第三级分类可能包括针对所显示的性行为类型的分类。

加州理工学院计算和神经系统教授,AWS 顾问 Pietro Perona 说:「现在,机器的风格是非常写实的,它会告诉你『里面有这些东西』。但是,科学家希望能做到的不仅限于此,他们还希望机器能说出这些人在想什么,正在发生什么事情。这就是该领域希望的发展方向,而不仅仅是像购物清单一样列出图像里面有什么。」

这其中的微妙差别对于内容审核来说至关重要。图像是否包含潜在令人反感的内容可能取决于图像里面的人意图是什么。

甚至对 「不安全」 或 「令人反感」 的定义也是一个不断变化的目标。它会随时间变化,并且在不同的地方意义会有所不同。Perona 解释说,上下文就是一切。暴力图片就是一个很好的例子。

Perona 说:「暴力在某种情况下可能是不可接受的,例如在叙利亚发生的现实生活中的暴力,但在另一种情况下是可接受的,例如在足球比赛中或在昆汀・塔伦蒂诺的电影中的那些。」

与众多 AWS 服务一样,Amazon 不仅把 Rekognition 的内容审核工具出售给其他人:它还是自己的客户。该公司表示,正在利用该服务来监管自己市场里面伴随着用户评价提交过来的用户生成图像和视频。