ChatGPT 们能讲人话后,AI 污染互联网将变本加厉

人类最担心的事情还是发生了。

随意在网上看几篇新闻,却分不清是出自 AI,还是人类之手;忙里偷闲时打把游戏,也分不清队友是 AI 人机还是真人。

直播间里,明星数字人自顾自地吮鸡爪,与卖力吆喝的真人助播形成割裂的场景……

据外媒 404 media 报道,一个原本用来追踪和分析多种语言中不同单词和词汇流行度和使用频率的项目——Wordfreq,现在也成了最新的受害者。

阳光明媚的地方总有阴影潜伏,显然 Wordfreq 不是第一个受害者,也不会是最后一个受害者。

换句话说,最终为之买单的或许还是人类本身。

GPT 们污染语言,人类要为之买单

「生成式 AI 污染了数据,我认为没有人掌握关于 2021 年后人类使用语言的可靠信息。」

这句来自 Wordfreq 项目创建者罗宾·斯皮尔心中的呐喊,透出了几分无奈与愤懑。

要探究这背后的原委,还得从 Wordfreq 的来历谈起。

通过分析维基百科、电影和电视字幕、新闻报道、以及 Reddit 等网站内容,Wordfreq 试图追踪 40 多种语言的变迁,进而研究随着俚语和流行文化变化而不断变化的语言习惯。

对于语言学家、作家和翻译人员而言,Wordfreq 无疑是一项宝库。但是现在,GitHub 地址上偌大的一句声明「该项目将不再更新」,也悲情地给这个项目敲响了丧钟。

曾经,网络抓取公开数据是该项目数据源的生命线,但生成式 AI 的崛起让 AI 文本开始大行其道。

斯皮尔举了一个典型的例子,过去人们很少使用「delve」这个词,而随着 ChatGPT 将这个词汇变成了口头禅,大有李鬼冒充李逵之势,间而也就让失真的词频统计影响了对人类语言习惯的准确分析。

如果这还不够直观,GPT 们那些陈词滥调,比如「总之」、「综上所述」等词汇的泛滥便是最醒目的警告。

这种趋势也正逐渐渗透到学术写作乃至文学创作中。

一份来自斯坦福大学的报告曾指出,ChatGPT 在短短五个月内,就成了许多专家学者们的「写作神器」。其中在计算机科学领域,几乎每六篇摘要、每七篇引言中,就有一篇出自它的手笔。

随之而来的,便是生成式 AI 对人类写作风格的「大举入侵」。

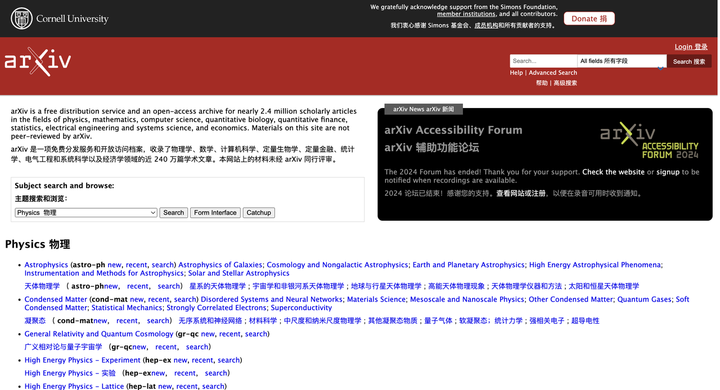

意大利国际高等研究院的博士生耿明萌的研究成果就像一面镜子,进一步映照出 ChatGPT 的词语偏好,也充分证实了它在学术论文写作中的影响力。

在分析 arXiv 上超过百万篇论文的摘要后,耿明萌发现,论文的词频在 ChatGPT 普及后出现了明显变化。其中,「significant」等词汇的使用频率大幅上升,而「is」和 「are」等词汇则减少了约 10%。

多数情况下,生成式 AI 可以让一个创造力 60 分的人变成 70 分甚至更高的分数,但在文本创作中,虽然个人创造力和写作质量有所提高,却在无形中让集体创意变得无趣且同质化。

UCL 和埃克塞特大学的两位学者在《Science》上发表了一项研究,500 名参与者被指派借助 AI 围绕随机主题撰写约 8 行故事,并分析目标受众。

结果显示,借助 AI 的灵感,故事变得更有「创造性」,但这些 AI 生成的故事彼此之间的相似度也惊人地高。

因此,当生成式 AI 文本如同无孔不入的污染物,肆意涌入互联网,对于 Wordfreq 也好,还是人类也罢,怎么看都是利远小于弊。

反爬虫战争打响,Wordfreq 遭殃

Wordfreq 项目的终止算得上是巨头爬虫战争夹缝中的牺牲品。

AI 的发展离不开算法、算力和数据的支持。尽管 AI 生成的文本与人类真实语言相比还有差距,但它在语法和逻辑性方面越来越像模像样。

这片风平浪静的水面之下,一场 AI 爬取与反爬取的无声战争正在酝酿。

在当前的舆论环境中,爬取网页数据似乎成了冒天下大不韪的禁忌,不少新闻报道评论区里充斥着网友的唾弃之声,而 Wordfreq 本质上也是通过爬取不同语言的文本而构建起来的。

在生成式 AI 尚未盛行之时,Wordfreq 也曾度过一段蜜月期。

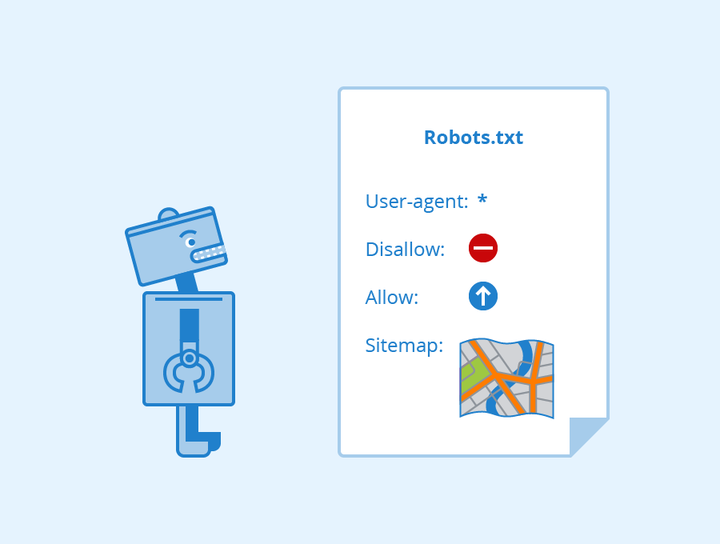

以往一般来说,只要遵守网站的 robots.txt 文件规定,爬取公开数据似乎也合情合理。这是网站与爬虫之间的一种默契约定,用来指示爬虫哪些内容可以抓取,哪些则不可以。

当一个网站设置 robots.txt 限制协议时,就像竖起了禁止擅自进入的标志牌。如果爬虫违反了 robots.txt 协议,或者采用了突破网站反爬虫技术手段的方法获取数据,那么就可能会构成不正当竞争或侵犯版权等违法行为。

然而,随着模型对高质量数据的灌溉需求日益增长,这场爬取与反爬取的战也愈发激烈。

回顾过去,关于生成式 AI 巨头爬虫与反爬虫数据的纠纷比比皆是。为首突出的自然是 OpenAI 和 Google。

去年,OpenAI 公司特地推出网络爬虫工具 GPTBot,声称用于抓取网页数据训练 AI 模型。但显然,没有哪家媒体愿意被爬虫暗地里薅羊毛。

意识到数据和版权重要性的媒体遵循着一手交钱,一手交数据的商业逻辑。

一项来自路透社研究所进行的研究表明,截至 2023 年底,全球 10 个国家的热门新闻网站中,近一半的网站屏蔽了 OpenAI 的爬虫(Crawler),而近四分之一的网站也对 Google 的爬虫采取了相同的措施。

后来的故事大家应该都很熟悉了,OpenAI 三天两头就被传统媒体起诉,无一例外不是版权诉讼纠纷。直到今年,官司缠身的 OpenAI 才老老实实和新闻出版商建立合作关系。

只是,此前的高墙林立、以及数据收费等策略也让 Wordfreq 也成为了这场「数据荒」的牺牲品。

斯皮尔指出,由于 Twitter 和 Reddit(Wordfreq 包含的网站)已经开始对其 API 收费,这使得网络抓取数据变得更加困难。

「过去免费获取的信息变得昂贵,」斯皮尔写道。「我不想参与任何可能与生成式 AI 混淆的工作,或可能使生成式 AI 受益的工作。」

即便能用金钱换数据,但数据总有用尽的一天。

研究公司 Epoch AI 预测,互联网上可用的高质量文本数据或将在 2028 年耗尽,这一现象在业内被称为「数据墙」,可能成为减缓 AI 发展的最大障碍。

于是乎,不少大模型厂商开始将目光转向合成数据,主打一个用 AI 训练 AI。

用 AI 训练 AI,可能越练越「傻」

我的直觉是,网络上的文本都是狗屎,这些数据上进行训练简直是在浪费算力。

当 Llama 3.1-405B 以掀桌子的实力横扫一众开源大模型之时,领导 Llama 系列的 Meta AI 研究员 Thomas Scialom 在接受采访时发出了如上暴论。

据他透露, Llama 3 的训练过程并不依赖任何人类编写的答案,而是完全基于 Llama 2 生成的合成数据。

Scialom 的说法或许过于粗暴,但也有一定的道理。

互联网每天都在涌现源源不断的数据,但训练 AI 从来就是一个宁缺毋滥的单选题,若数据中满是错误和噪声,模型自然也会跟着学习这些「瑕疵」,预测和分类的准确性可想而知。

而且,低质量的数据往往充斥着偏见,无法真正代表整体数据分布,从而导致模型产生有偏见的回复。教科文组织总干事阿祖莱也曾警告:

「新的 AI 工具有着在不知不觉中改变千百万人认知的力量,因此,即便是生成内容中极为微小的性别偏见,也可能显著加剧现实世界中的不平等。」

不过,合成数据也未必是解决「数据墙」难题的灵丹妙药。

最近来自牛津剑桥的研究人员发现,当模型使用 AI 生成的数据集,则输出的质量会逐渐下降,最终产生无意义的内容,也就是俗称的模型崩溃。

研究负责人 Ilia Shumailov 用了拍照的比喻来形容这一过程:

如果你拍了一张照片,扫描、打印出来并再对其拍照,然后不断重复这个过程,随着时间的推移,基本上整个过程都会被「噪声」淹没。最后,你会得到一个黑暗的方块。

当越来越多 AI 生成的垃圾网页开始充斥互联网,训练 AI 模型的原材料也将遭到污染。

例如,程序员问答社区 Stack Overflow 深受 AI 其害。

在 ChatGPT 爆火之初,Stack Overflow 便宣布「临时禁用」。「从 ChatGPT 获得正确答案的平均比例太低了。」官方在声明中如是吐槽。

专业用户的数量毕竟有限,不可能逐一核实所有答案,而 ChatGPT 的错误率又是显而易见的。当 AI 污染社区环境,彼时无计可施的人类也只能一禁了之。

在图像领域,AI 模型趋向于重现最常见的数据,经历多次迭代后,最终可能连最初的事物都会忘得一干二净。

被看到的这一切指向了一个恶性循环:AI 生成低质量乃至错误信息,与人类数据混淆在一起,这些普遍低质量的数据又被 AI 反复喂养,最终导致肆意泛滥的 AI 反噬自身。

而人类如果意识到昔日的数据足迹会成为喂养自己的养料,或许我们会更加谨慎地对待在互联网留下的每一句话。